为什么本地部署DeepSeek有不可替代的价值?——打破误解与实战指南

引言:被低估的本地部署在ai技术蓬勃发展的今天,大型模型(如deepseek、llama、chatglm等)的部

引言:被低估的本地部署在ai技术蓬勃发展的今天,大型模型(如deepseek、llama、chatglm等)的部署方式往往被认为与“云端”绑定。许多人认为,本地部署(on-premise deployment)成本高、维护复杂,在云服务唾手可得的时代已失去意义。但事实真的如此吗?

引言:被低估的本地部署在ai技术蓬勃发展的今天,大型模型(如deepseek、llama、chatglm等)的部署方式往往被认为与“云端”绑定。许多人认为,本地部署(on-premise deployment)成本高、维护复杂,在云服务唾手可得的时代已失去意义。但事实真的如此吗?

本文将挑战这一观点,剖析本地部署的核心价值,并提供实战教程资源,帮助开发者与企业重新评估这一技术选择。

误解与真相:本地部署的五大不可替代优势1. 数据主权与隐私合规痛点:金融、医疗、法律等行业的数据敏感性和合规要求(如GDPR、HIPAA)使得云端传输存在风险。 优势:本地部署确保数据始终留在私有环境中,避免第三方泄露风险。例如,某医疗机构使用本地化DeepSeek处理患者病历,完全规避了云端API调用可能引发的合规争议。 2. 离线场景与实时性痛点:制造业工厂、偏远地区或机密实验室的网络条件不稳定,云端服务延迟可能影响关键任务。 优势:本地部署支持完全离线运行,且响应速度更快(无需网络往返)。例如,某汽车工厂在质检流水线部署本地模型,实现毫秒级缺陷检测。 3. 长期成本可控性误区:云服务看似“按需付费”,但长期高频调用成本可能远超预期。 真相:本地部署的硬件一次性投入后,边际成本趋近于零。对于中大型企业,3-5年内总成本通常低于云端方案(参考测算)。 4. 定制化与深度优化灵活性:本地环境允许对模型进行底层修改(如量化、剪枝、硬件适配),而云端服务通常仅提供标准化API。 案例:某研究团队通过本地部署DeepSeek,结合自有知识库进行增量训练,构建出垂直领域专用模型,准确率提升40%。 5. 技术主权与抗风险能力风险规避:依赖云端服务可能受供应商定价策略、服务中断或政策变化影响(如近期某云厂商突然终止特定区域服务)。 主动权:本地部署将核心技术栈掌握在企业内部,避免被供应商“锁定”。---

实战场景:谁更需要本地部署?金融机构:高频交易风控模型需毫秒级响应,且数据禁止外传。 政府与军工:政策强制要求数据本地化存储与处理。 制造业与物联网:工厂内网环境需离线运行AI质检或预测性维护。 研究机构:需修改模型架构或训练过程的创新性实验。 ---

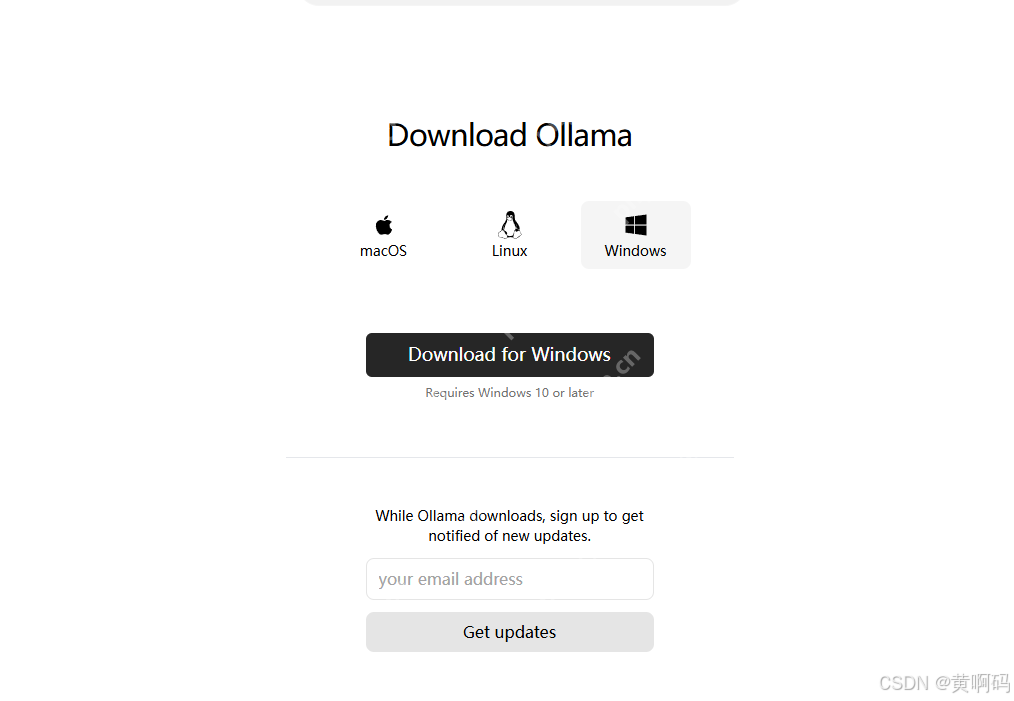

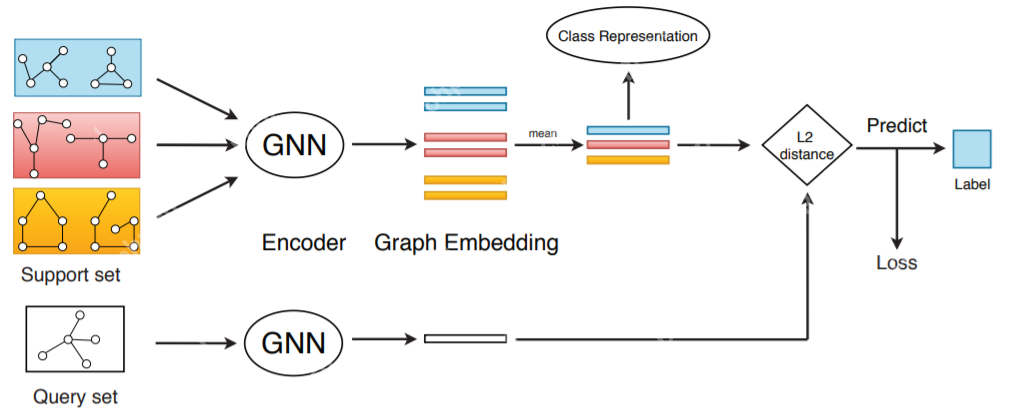

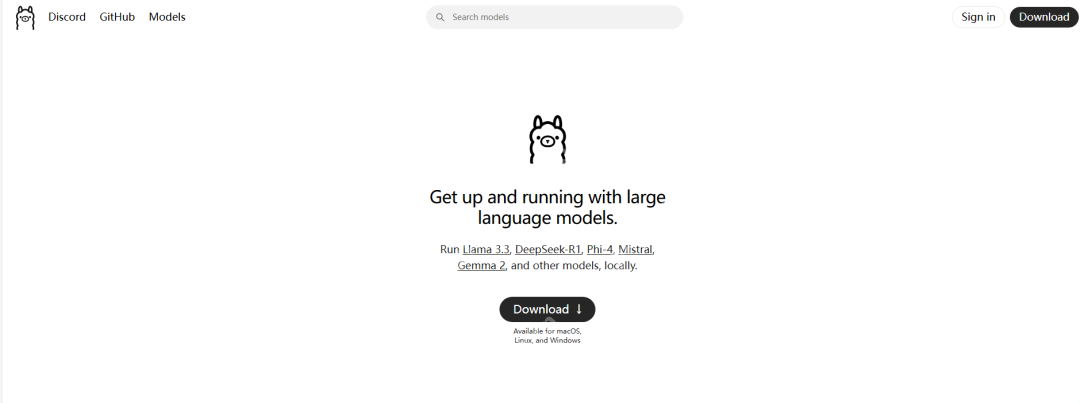

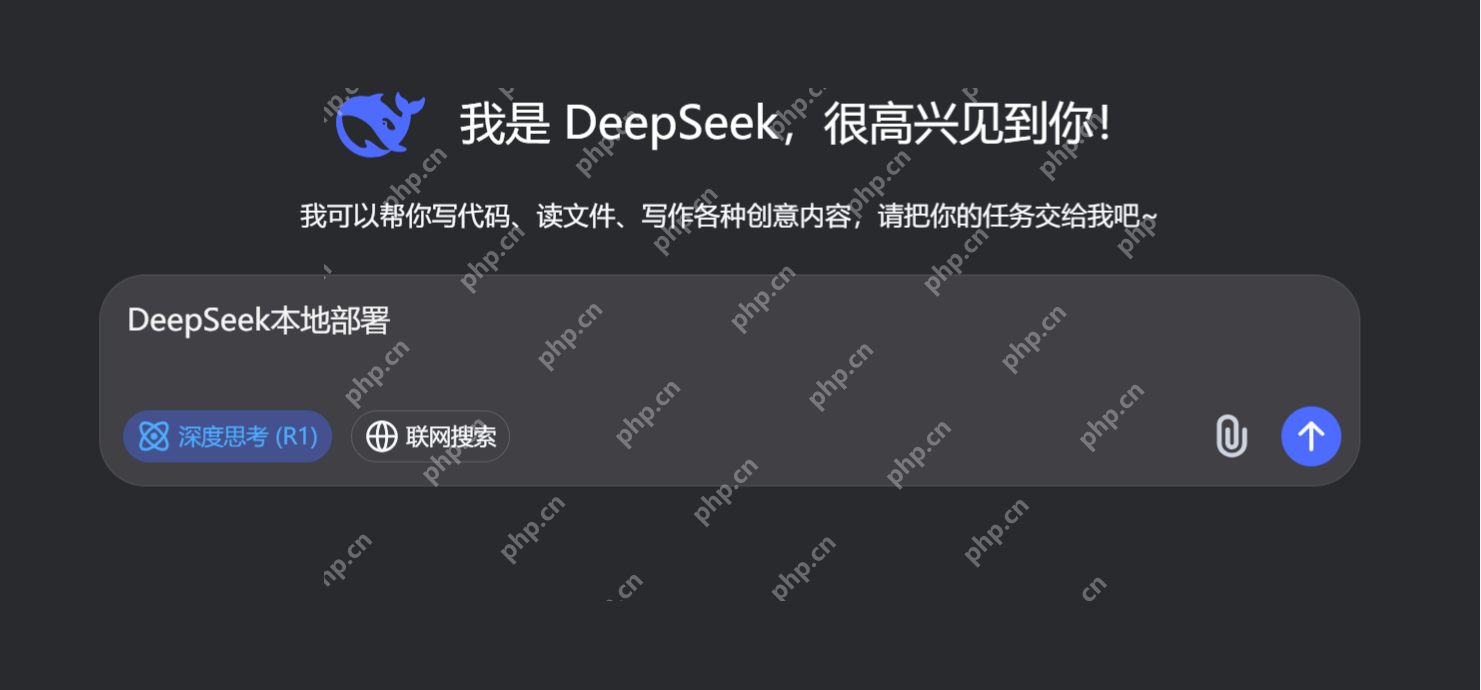

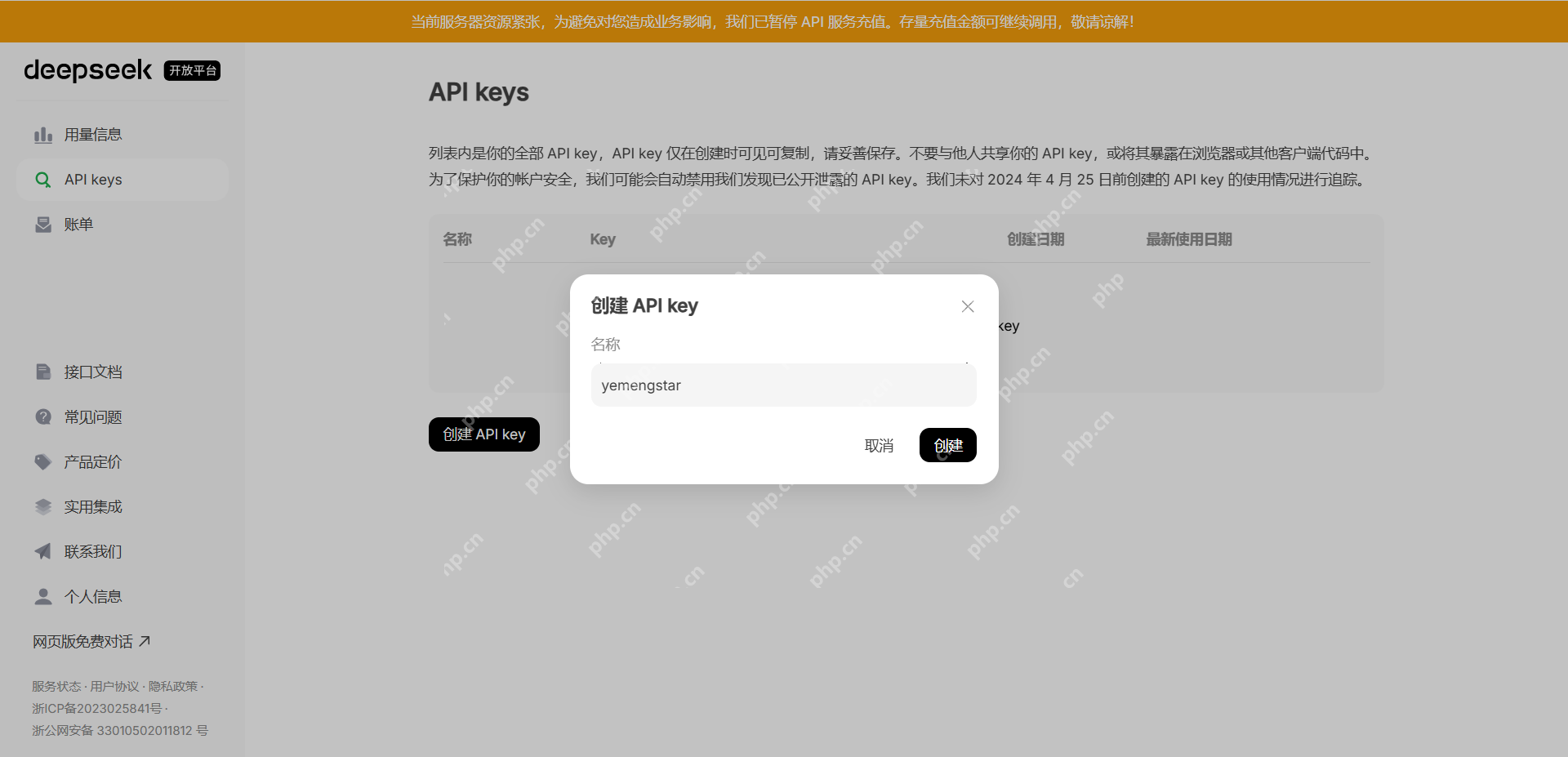

本地部署DeepSeek简明教程与资源1. 基础环境搭建硬件要求:建议至少16GB显存(如NVIDIA A10G/T4)及32GB内存。详细配置指南 依赖安装:通过Docker快速部署环境,避免依赖冲突: docker pull deepseek/deploy:latestdocker run -it --gpus all deepseek/deploy2. 模型量化与优化使用开源工具链(如GGUF、AutoGPTQ)压缩模型体积,提升推理速度: from auto_gptq import quantize_modelquantize_model(model_path="deepseek-7b", output_path="deepseek-7b-4bit")教程推荐: HuggingFace模型量化实战 ONNX Runtime性能调优 3. 私有知识库集成使用LangChain或LlamaIndex连接本地向量数据库(如Milvus): from langchain.retrievers import DeepseekRetrieverretriever = DeepseekRetriever(local_model_path="deepseek-7b", db_path="milvus_db")4. 监控与维护推荐Prometheus+Grafana监控GPU利用率与API性能:部署方案 ---

结语:技术选型的本质是“权衡”本地部署绝非“过时技术”,而是与云端互补的核心选项。当企业面临数据敏感、长期成本、定制需求等场景时,它仍是不可替代的解决方案。技术决策者需跳出“非黑即白”的思维,根据实际需求选择最优路径。

延伸阅读:

DeepSeek官方本地部署文档 大模型私有化部署白皮书

菜鸟下载发布此文仅为传递信息,不代表菜鸟下载认同其观点或证实其描述。

相关文章

更多>>热门游戏

更多>>热点资讯

更多>>热门排行

更多>>- 极品天尊手游排行-极品天尊免费版/单机版/破解版-极品天尊版本大全

- 金刚之印最新排行榜-金刚之印手游免费版下载-金刚之印免费破解版下载

- 炽焰传奇最新排行榜-炽焰传奇手游免费版下载-炽焰传奇免费破解版下载

- 欧陆风云系列版本排行-欧陆风云系列游戏有哪些版本-欧陆风云系列游戏破解版

- 多种热门耐玩的忍者学园破解版游戏下载排行榜-忍者学园破解版下载大全

- 2023圣剑生存手游排行榜-圣剑生存手游2023排行榜前十名下载

- 百龙霸业手游2023排行榜前十名下载_好玩的百龙霸业手游大全

- 谋略天下游戏版本排行榜-谋略天下游戏合集-2023谋略天下游戏版本推荐

- 渡劫封神手游排行-渡劫封神免费版/单机版/破解版-渡劫封神版本大全

- 传奇续章排行榜下载大全-2023最好玩的传奇续章前十名推荐

- 放置少女系列版本排行-放置少女系列游戏有哪些版本-放置少女系列游戏破解版

- 森系少女排行榜下载大全-2023最好玩的森系少女前十名推荐

热门攻略

更多>>

手机扫描此二维码,

在手机上查看此页面

版权投诉请发邮件到 cn486com#outlook.com (把#改成@),我们会尽快处理

Copyright © 2019-2020 菜鸟下载(www.cn486.com).All Reserved | 备案号:湘ICP备2022003375号-1

本站资源均收集整理于互联网,其著作权归原作者所有,如有侵犯你的版权,请来信告知,我们将及时下架删除相应资源